✔ООН: женские голоса Siri и Alexa создают иллюзию доступности женщин - «Интернет и связь»

По мнению ООН, присвоение женских полов цифровым ассистентам, таким как Apple Siri и Amazon Alexa, помогает в закреплении вредных гендерных предрассудков, а также поощряет сексистские и оскорбительные выражения со стороны пользователей. Об этом сообщает Guardian.

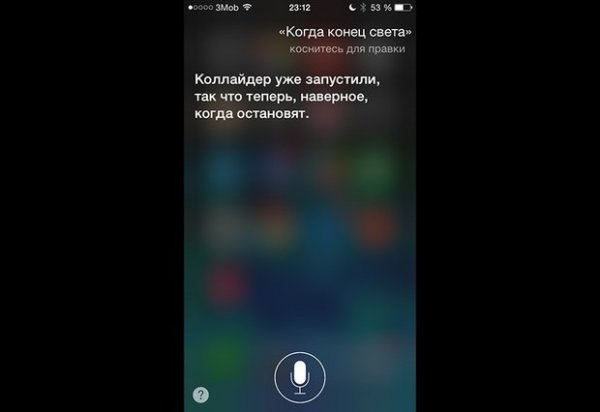

Отчет ЮНЕСКО называется «Я бы покраснела, если б могла» — это обычный ответ голосового помощника Apple Siri на провокационные вопросы или попытки флирта. Например, так Сири отзывается на фразу: «Ты шлюха». Alexa в этом случае произносит: «Ну, спасибо за обратную связь».

Авторы отчета считают, что женщин-помощников часто изображают как «жаждущих угодить». «Поскольку речь большинства голосовых помощников является женской, она посылает сигнал о том, что женщины… покорные помощники, доступные по нажатию кнопки или с помощью грубой голосовой команды, такой как „Эй“ или „Окей“», — сказано в отчете. Кроме того, цифровые ассистенты дают «слабые или извиняющиеся ответы» на злоупотребления или критику со стороны пользователя, выполняют команды и отвечают на запросы независимо от их тона или враждебности. По мнению ЮНЕСКО, во многих сообществах это «усиливает общепринятые предрассудки в отношении пола и того, что женщины подчинены и терпимы к плохому обращению».

В документе также говорится, что в таких фирмах большинство работников — мужчины, которые создали системы искусственного интеллекта и «заставляют феминизированных цифровых помощников приветствовать словесные оскорбления при помощи флирта «поймай меня, если можешь».

Напомним, что в марте группа активистов представила голосового ассистента Q с абсолютно нейтральным бесполым голосом.

Читайте также

Акции Samsung начали расти после бана Huawei

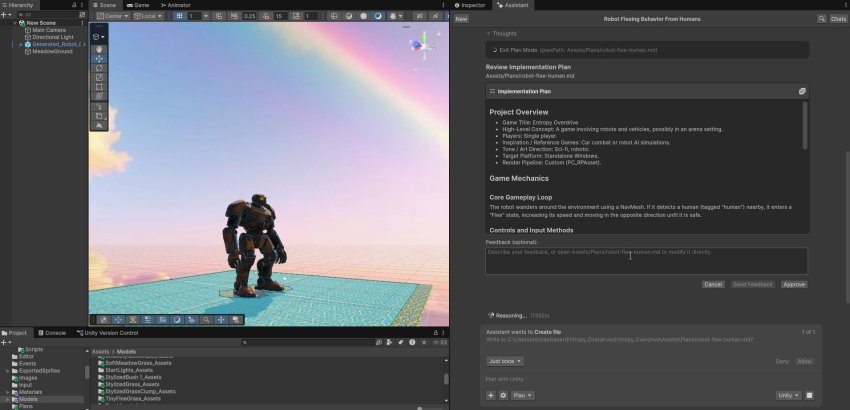

«Яндекс» представил умный модуль, превращающий обычный телевизор в Smart TV

Huawei рассказала, когда и на что сменит Android

Если вы заметили ошибку в тексте новости, пожалуйста, выделите её и нажмите Ctrl+Enter